近日,工业和信息化部、国家机关事务管理局、国家能源局三部门联合印发了《关于加强绿色数据中心建设的指导意见》,提出到2022年全国新建大型、超大型数据中心PUE需达到1.4以下。阿里巴巴所有自研数据中心平均PUE已经低于1.3,是国内首个达成该目标的公司。

PUE (Power Usage Effectiveness,电源使用效率)是衡量数据中心电力能源利用率的国际通用指标,越接近1表明能效水平越好。目前国内企业数据中心的PUE平均值在2-2.5,而国家标准是1.4以下,与指导意见提到的目标还有很大差距。

事实上,数据中心巨大的耗电量困扰着全球科技公司。据统计,全球数据中心的耗电总量占总用电量的3%,其中有约40%用于与业务无关的制冷系统,造成了能源的极大浪费。

阿里巴巴在绿色数据中心的研发上有丰富的实践经验,使用多种创新技术取代传统供电系统和空调制冷系统,阿里云智能技术设施事业部IDC技术研发负责人天吉透露,公司自研的数据中心整体平均PUE已经低于1.3。

其中在杭州的一处数据中心采用了深层湖水来制冷,最低PUE仅1.17,比普通数据中心全年节电数千万度,减少碳排放一万多吨。

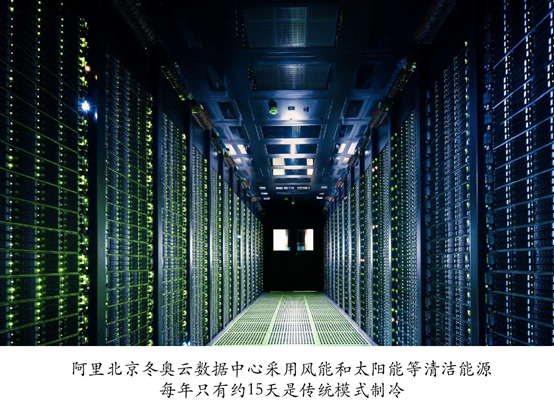

位于张北的北京冬奥云数据中心,同时采用风能和太阳能等清洁能源,充分利用自然能源,每年只有约15天是传统模式制冷,能耗降低59%,PUE最低至1.13,是全球最节能的数据中心之一。

不仅如此,该数据中心还部署了全球互联网行业最大规模的浸没式液冷服务器集群,不再使用传统机械制冷系统,PUE可逼近理论极限值1.0。

这也是缙哥哥为什么选择阿里云的原因!

绿色数据中心黑科技

接下来,缙哥哥带大家一起来看看阿里巴巴绿色数据中心平均PUE低于1.3的背后有五大黑科技:包括因地制宜降温、模块化设计加速搭建、用清洁能源节能、液冷服务器提效、人工智能巡检等。

用湖水替代空调降温

在杭州的一座数据中心里,阿里巴巴另辟蹊径,用深层湖水来给服务器降温,完美取代了传统空调制冷的方式,能源效率的提升立竿见影,最低PUE仅为1.17,与普通数据中心相比,全年可节电约数千万度,减少碳排放一万多吨。

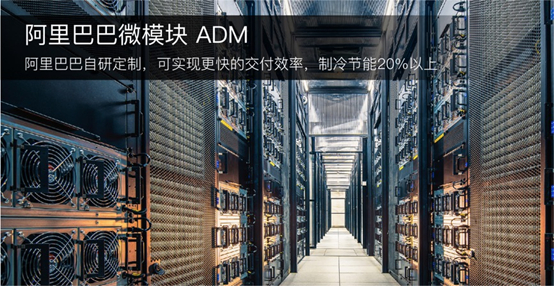

模块化设计,一座数据中心建设仅需1年

一般情况下,一座大型数据中心需要2~3年才能建成。但阿里突破了传统建造模式,仅用1年时间就建成了位于张北的北京冬奥云数据中心(两个园区)。秘密就是全模块化的设计理念,像乐高积木一样现场拼装。

清洁能源,每年可节省5.9万吨的碳排放

北京冬奥运云数据中心同时采用了风能和太阳能等清洁能源,充分利用自然能源,每年仅有约15天用到传统模式制冷,PUE最低可达1.13,相当于每年可节省5.9万吨的碳排放。

液冷服务器,PUE逼近理论极限值1.0

同样在北京冬奥云数据中心,部署了全球互联网行业最大规模的浸没式液冷服务器集群,其 PUE逼近理论极限值1.0,是目前最高水平。据了解,这是一种完全绝缘且无腐蚀性的液体,即使浸没元器件20年以上,也不会对电子元器件产生任何影响。

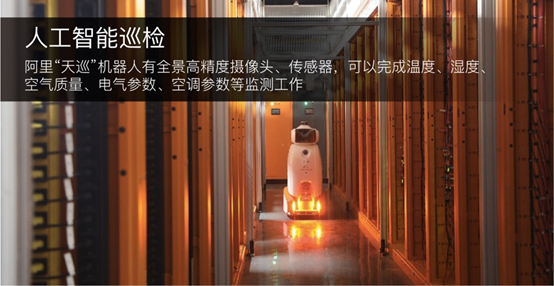

天巡机器人,用人工智能保障稳定性

稳定性是数据中心的核心指标之一,在保障稳定性上用机器人“天巡”辅助工作人员完成巡检工作,它带有全景高精度摄像头、传感器,在巡检中可以完成温度、湿度、空气质量、电气参数、空调参数等监测工作,去年双11期间接替了运维人员以往30%的重复性工作。

作为全球前三、国内第一的云计算服务商,阿里云拥有全球最丰富的云计算产品家族,包括绿色数据中心在内自研了一系列核心技术,包括超大规模通用计算云操作系统飞天Apsara、数据库POLARDB、弹性裸金属服务器神龙X-Dragon等。

目前,阿里云在全球19个地域建立了56个可用区,“未来,我们将持续提升数据中心能源效率,同时致力于全面实现智能化管理。”阿里巴巴集团副总裁周明表示。

缙哥哥

缙哥哥

![缙哥哥常用运行库下载汇总[2019.1更新]](https://img.dujin.org/images/windowsyunxingku.jpg)

图片挂了不少

好吧~_~我还是放我自己服务器比较稳妥